如何看待近两年火爆的一键脱衣软件?

去年6月,一款深度生产软件仅发布了几个小时,由于访问请求过多,该软件迅速关闭。 原因是它可以一键脱下女性的衣服,并产生大量的色情图片。

在本期《轻丫轻百科》,出现了“一键脱衣服”软件吗?

最近,根据调查,该色情软件再次出现在即时通讯应用程序Telegram中。

到目前为止,该软件已在TeleGram平台上公开发布了约104,852张色情图片。 此数据不包括私人共享的图像。 更重要的是,这些图片中有70%都是社交网络上的真实女性,甚至是未成年人。

换句话说,每天在社交媒体(例如Facebook和微博)上共享的自拍照可能会被用来生成“水果照片”。

DeepNude针对“您可能认识的人”

该调查来自总部位于阿姆斯特丹的网络安全公司Sensity,该公司专注于所谓的“视觉威胁情报”,尤其是那些 深入的假视频。 他们的调查发现,截至7月底,Telegram平台上的所有七个主要频道都在使用DeepNude软件。

该软件已吸引了全球103,585位用户,其中拥有最多用户的频道有45,615位。 这些用户大多数聚集在俄罗斯和东欧周围地区。

可以理解,此软件爆炸的原因有三个。 一是操作非常简单。 您只需要一张照片。 上传到软件后,无需任何技术知识或特殊硬件支持,即可在几秒钟内自动生成裸照。

第二个对所有人免费。 但是,它也有一个利润模型。 由未付费用户获得的裸照将带有水印或仅部分暴露。 用户可以支付1.28美元来获取未加水印的图片,但许可仅限于在7天内100张照片。

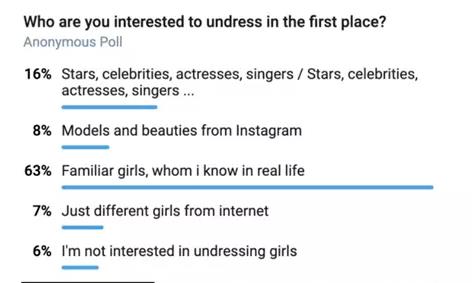

第三是获取熟悉的人的裸照。 Deepfake伪造主要针对名人的色情影片的情况并不少见。 但是,根据一项民意调查,大多数用户对“他们在现实生活中认识的妇女”更感兴趣,占63%。

而且DeepNude恰好提供了这种支持,任何用户都可以使用任何照片生成裸照。

从TeleGram平台上的公开数据来看,照片中的许多女性是普通上班族,大学生,这些照片都是来自TikTok,Instagram和Facebook等平台的自拍照。

应该指出的是,这种深度欺诈软件仅适用于女性。 如果您上传男性或其他无生命的照片,则系统将自动替换为女性的身体,并被识别为相应的器官。

感性首席科学家乔治·帕特里尼(George Patrini)说,超过680,000名妇女被伪装成色情图片,不知情,并被上传到公共媒体平台。

目前,Sensity的相关调查数据已经公开,相关执法机构也已展开调查。 到目前为止,Telegram尚未就为何允许该色情软件出现在社交平台上给出公开答案。

另外,根据一项Sensity调查,除Telegram之外,另一个俄罗斯社交媒体平台VK还发现了DeepNude,并已开始公开宣传该软件。

但是,事件一旦发生,相关负责人立即做出回应,并否认了这一说法。 同时,他强调VK不会容忍平台上的此类内容或链接,而且还会阻止社区分发这些内容或链接。 此外,此类社区或链接不使用VK广告工具进行促销。 我们还将进行其他检查,并防止出现不适当的内容。

创作者:我不是出于好奇而偷窥

但是,这是一种色情伪造软件,最初是出于好奇和对技术的热情而创建的。

2019年6月27日,DeepNude软件首次公开发布,此后不久,由于用户流量过大,系统关闭。

但是在这几个小时中,这种针对妇女的“一键式脱衣AI”在国内外引起了轩然大波。

在诸如Twitter,Reddit和Weibo等主要社交媒体平台上已经出现了有关“侵犯隐私和性别歧视”的指控。 深度学习先驱Wu Enda也发推文说DeepNude是“人工智能中最令人恶心的应用之一”。

针对外界的各种指责,其开发商Alberto公开回应:“这个世界还没有为DeepNude做好准备!” “我不是偷窥狂。我是技术爱好。

同时,他强调:“我不在乎裸照。有些人不想使用它们,但是他们只是想让其他人不使用它们。这很愚蠢。阻止 审查技术知识是不可能的。阻止其传播。”

据了解,阿尔贝托的研发灵感来自杂志上的X射线眼镜。 他对AI技术非常感兴趣。 当他发现GAN网络可以将白天的照片转换为夜景照片时,他意识到同一个GAN也可以用于将带有衣服的照片转换为没有衣服的照片。

正是这种好奇最终发展了DeepNude。

具体来说,DeepNud是基于名为“ pix2pix”的开源“图像到图像翻译”软件构建的,该软件于2018年由加利福尼亚大学伯克利分校的AI研究人员首次发现。

它的核心技术GAN可以通过识别真实图像来制造自己的假货。 例如将风景照片从白天更改为晚上或从黑白更改为全彩色。

但是,无论是出于好奇还是出于技术研发的准确性,该软件的确滥用了AI技术并产生了不良影响。

正如著名作家尼娜·扬科维奇(Nina Jankovic)所说,DeepNude对全世界的女性都有巨大的影响力,特别是在俄罗斯这样具有保守社会的国家。 如果令人信服但虚假的裸照公开发表,受害者可能会失业或面临伴侣暴力。

感性还指出,这些虚假的色情图片或视频很可能被用作勒索和骚扰的手段。

Deepfake威胁很大,[r]

不仅是DeepNude,还包括所有对于epfake软件来说是这样。

正如波士顿大学法学教授Danielle Citron所说:“深层假装已成为对抗妇女的有力武器。”

Deepfake的深层伪造软件背后的核心技术是生成对抗网络GAN。 GAN通过生成器和区分器之间的相互斗争,生成逼真的假图像,视频或声音。

自2017年以来,在Deepfake首次用于制作色情影片(《神奇女侠》海上事件)之后,社交网络开始被此类影片所淹没。 据统计,在所有Deepfake创建的视频中,色情视频占96%。

随着技术的不断升级,Deepfake的保真度已达到肉眼无法分辨的程度,并且也已开始应用于政治领域。

唐纳德·特朗普,巴拉克·侯赛因·奥巴马,伊隆·马斯克等名人政客的虚假换脸视频并不少见。

根据普林斯顿大学教授雅各布·夏皮罗(Jacob Shapiro)的最新研究结果,2013年至2019年间,社交媒体发起了96次政治运动,其中93%是原始内容,86%放大了现有内容,74%歪曲了客观事实。

其目的主要是为了抹黑政客,误导公众,加剧矛盾。

为了应对Deepfake软件带来的威胁和挑战,Facebook在2019年投入巨资发起了“ Deepfake检测挑战赛”。

今年Deepfake检测的识别准确率达到82.56%。

此外,学术界和其他公司团队也在开发深层检测方法。 然而,尽管检测方法的数量增加并且准确性更高,但是创建虚假视频的趋势并未得到很好的抑制。

原因之一可能是AI生成虚假内容越来越方便。 例如,DeepNude只需要一张照片,每个人都可以使用它。

第二,正如Sensity负责人所说,DeepNude仍然处于合法的灰色地带。 因此,要关闭Deepfake Pandora盒子,需要制度上的限制和人们的指导。